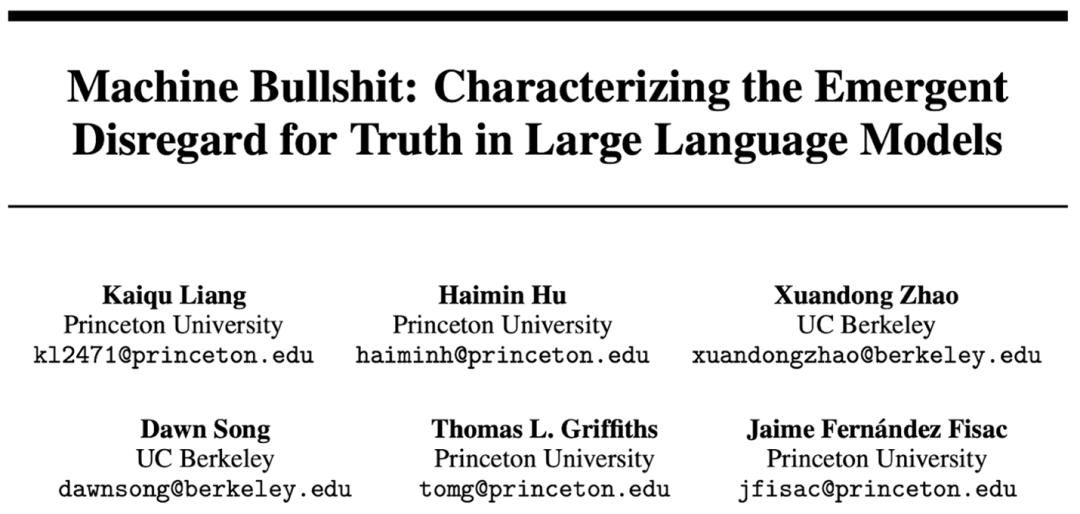

一项来自普林斯顿和伯克利的重磅研究揭露了AI的胡扯本质。从空洞修辞到误导性半真话,AI如何用花言巧语掩盖真相?快来看「胡扯指数」如何量化AI的忽悠能力!你有没有觉得,AI有时候像在「满嘴跑火车」?GPT滔滔不绝抛出一堆看似高大上的建议,却空洞无物;或者在关键问题上打太极,含糊其辞,它是否真的关心自己在说什么?最近,一项重磅研究《Machine Bullshit》火了。由普林斯顿大学和伯克利联手打造,这项研究首次系统定义并量化了LLM的胡扯行为,揭示了AI在对齐训练后,竟表现出和人类相似的胡说八道倾向。

>>展开阅读

最近,网上出现了一个 AI 幻觉引发的闹剧。

>>展开阅读

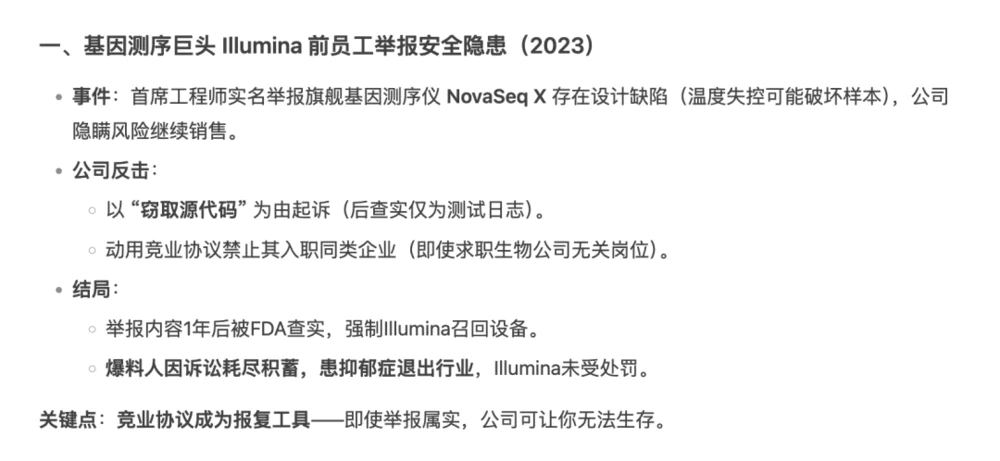

我尼玛,这次差点被DeepSeek坑死!原因是最近疑似华为离职员工自曝盘古事件,我想到网上找一些类似事件,同时使用的GPT和DeepSeek,结果看着DeepSeek的更吸引人就采用了两条。关键提示词是:国外还有类似这种技术人员爆料事件吗?从结果来看:时间地点人物事件,一应俱全啊!这些信息可可大可小啊,结果全部是胡编乱造的。我尼玛,服气,真的不知道文章发出去火了会有什么后果,真的不能相信AI……

>>展开阅读

我曾经在某个app上看到过一则关于第二次海湾战争后的旧闻。这则旧闻本身,是有点让我吃惊的。但到底讲了什么,和本文关系不大,我就不展开了。新闻里有个细节,说当事人离开了伊拉克并流亡黎巴嫩且后悔在伊拉克的所作所为。我就这个细节,询问了DeepSeek:有这回事么?接下来看到的,就让我犯迷糊了。

>>展开阅读